AIの知能は、データ(Data)・計算量(Compute)・モデルサイズ(Model Size)という3つの要素で予測可能なほど決まる——これが、Anthropicが2021年から静かに賭けてきたスケーリング則(scaling law)のレシピだ。

People by WTF · Nikhil Kamath

AIの津波はすでに来ている & 社会はまだ準備ができていない

Dario Amodei(Anthropic CEO)× Nikhil Kamath

YouTubeで視聴する ↗

People by WTF · Nikhil Kamath

Dario Amodei(Anthropic CEO)× Nikhil Kamath

YouTubeで視聴する ↗

重要なポイント

AIの知能は、データ(Data)・計算量(Compute)・モデルサイズ(Model Size)という3つの要素で予測可能なほど決まる——これが、Anthropicが2021年から静かに賭けてきたスケーリング則(scaling law)のレシピだ。

AnthropicはChatGPTが存在する前から動作するAIモデルを持っていたが、リリース競争よりも安全性審査を優先して秘密裏に保留した——アモデイが今もなお擁護する決断だ。

コーディングは廃れゆくスキルだ。AIがあらゆるタスクの汎用実行者になる中で、批判的思考こそが人間に残された最後の優位性である。

AI権力が少数の企業に集中することは深刻な問題だ——そしてアモデイ自身も、それを握っている一人であることを認めている。

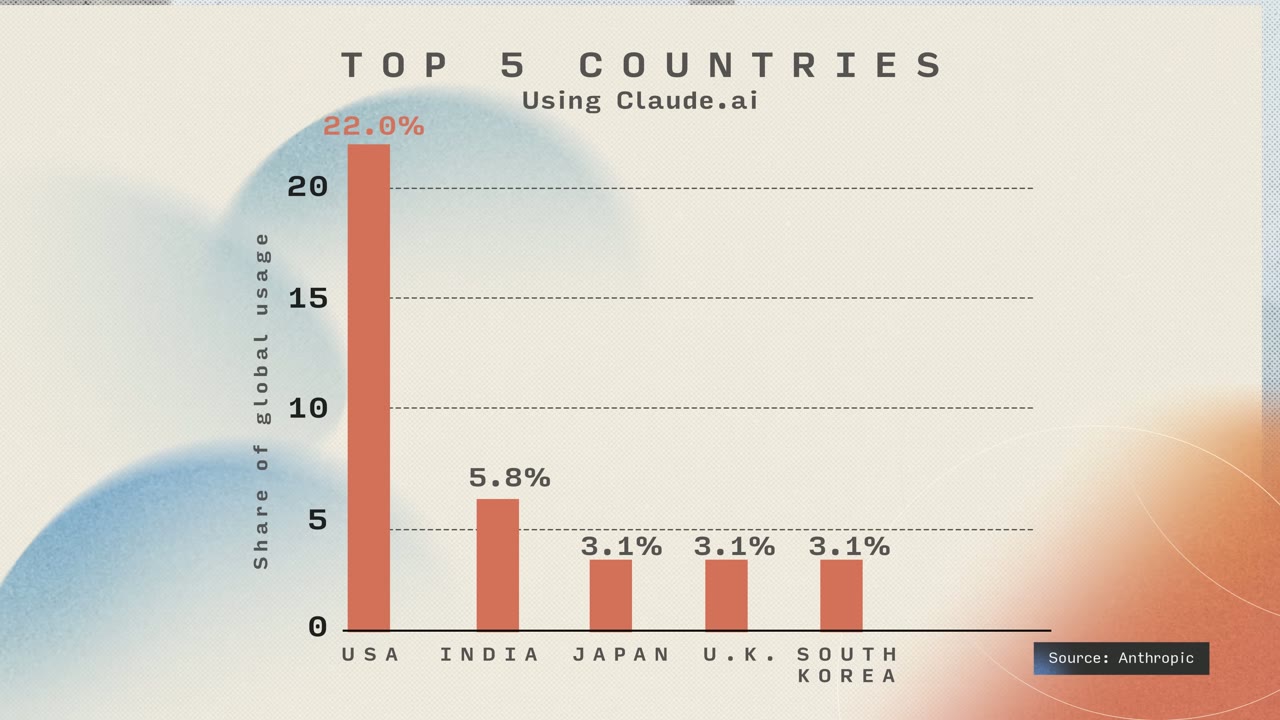

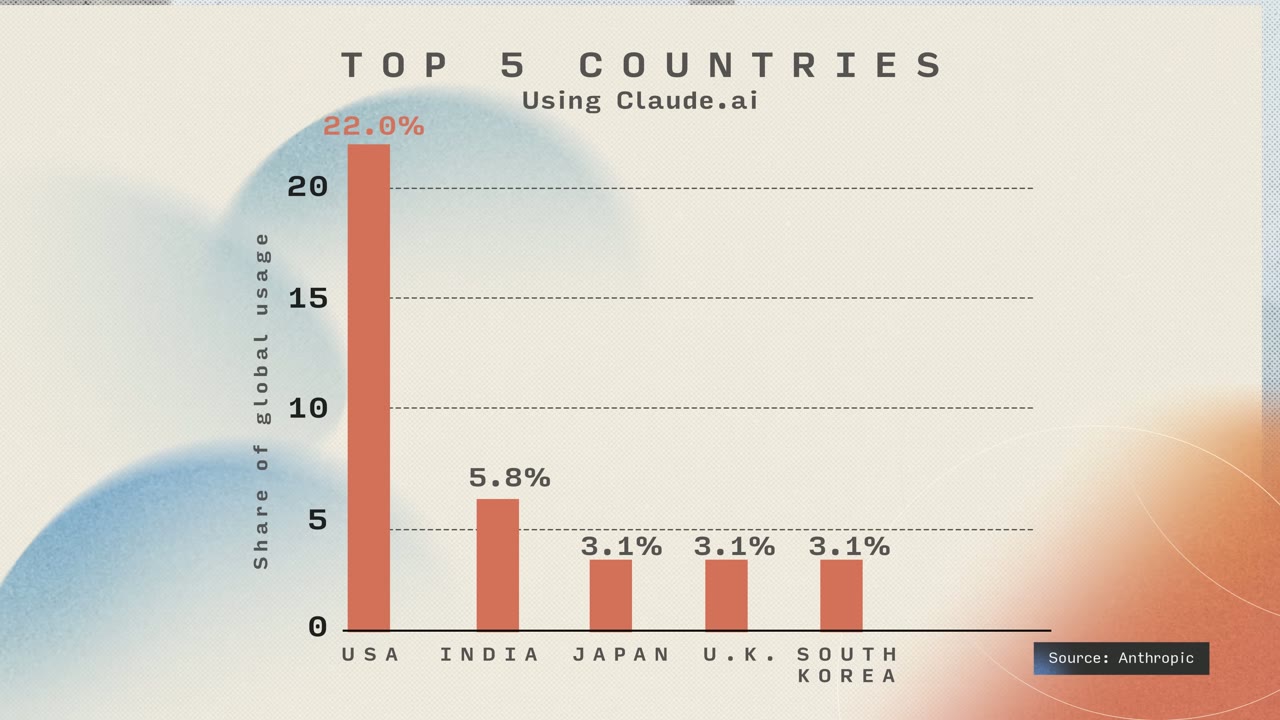

インドはClaudeの世界利用国第2位で5.8%を占め、米国の22%に次ぐ。数字は揃っている——あとはインフラが追いつく必要がある。

バイオテクノロジーが次の兆ドル規模の波になる。AIは50年分の医療の進歩を10年に圧縮し、多くの疾患を治癒できる可能性がある。

オープンソースAIは制御不能な拡散リスクを生み出す。クローズドモデルは少なくとも一つの安全チョークポイントを維持できる——アモデイが現実的に擁護するトレードオフだ。

会話の流れ

0:00

バンガロールでニキルが場を設定する。ダリオは生物学者として現れ、AIで最も慎重なビルダーとなった人物だ。

6:13

そのレシピ:データ + 計算量 + モデルサイズ = 知能。シンプルな経験則がどのようにAI開発の行方を変えたか。

13:27

なぜAnthropicはリリース前にモデルを数ヶ月間保留したのか。Anthropicを法的にユニークにするガバナンス構造——Long-Term Benefit Trust(長期利益信託)——について。

22:44

アモデイの日常的なClaude利用について。AIが深くコンテキストを把握する夢——そしてそれが提起するプライバシーの問い。

31:03

テック億万長者が権力集中を警告しながら自ら蓄積するという矛盾。アモデイはその問いを避けない。

37:05

インドはClaude利用国で世界第2位。ITアウトソーシングからAIネイティブ企業への移行。そして実際の機会がどこにあるか。

44:15

アモデイの答え:おそらくそうなる、そしてほとんどの人が予想するより早く。それが人間の目的やアイデンティティに何を意味するか。

50:17

AIが自動化するスキルを最適化しないこと。AIシステムと競争するのではなく、判断力・創造性・AIを指揮する能力を構築せよ。

56:38

クローズドモデルの安全チョークポイント論。なぜアモデイはオープンソースの拡散が取り戻せないリスクを生み出すと考えるか。

1:02:40

生物学に適用されるAI:疾患の治癒、老化の逆転、何十年分もの医療進歩の圧縮。これがダリオが生物学者として出発した理由だ。

ビジュアルハイライト

図解

6:26

図解

6:26

スケーリング則:データ(DATA) + 計算量(COMPUTE) + モデルサイズ(MODEL SIZE) → 知能(INTELLIGENCE)

根拠

2:08

根拠

2:08

Anthropic設立前:ダリオの2012年Nature Biotech論文(質量分析・プロテオミクス)

図解

44:57

図解

44:57

Claude.ai利用国トップ5の棒グラフ——インドが世界第2位

根拠

15:32

根拠

15:32

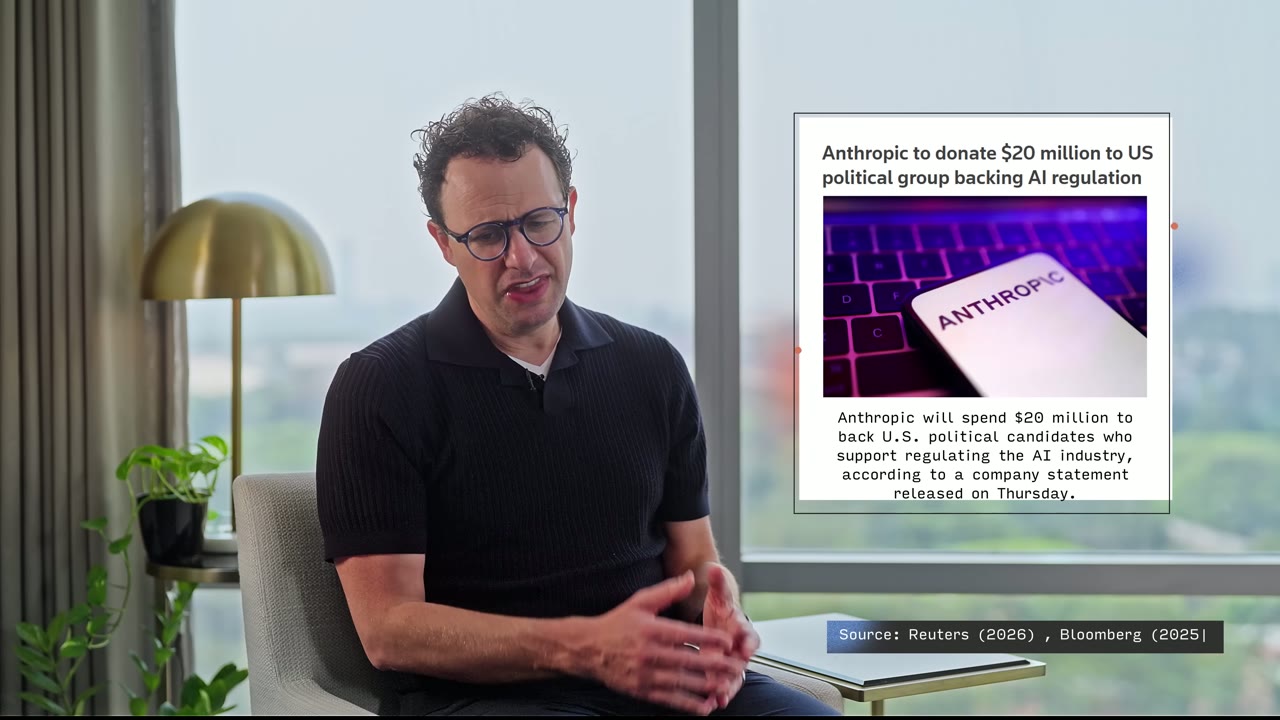

Anthropicが米国AI規制支持団体に2000万ドルを拠出——資本で政策を後押し

根拠

16:36

根拠

16:36

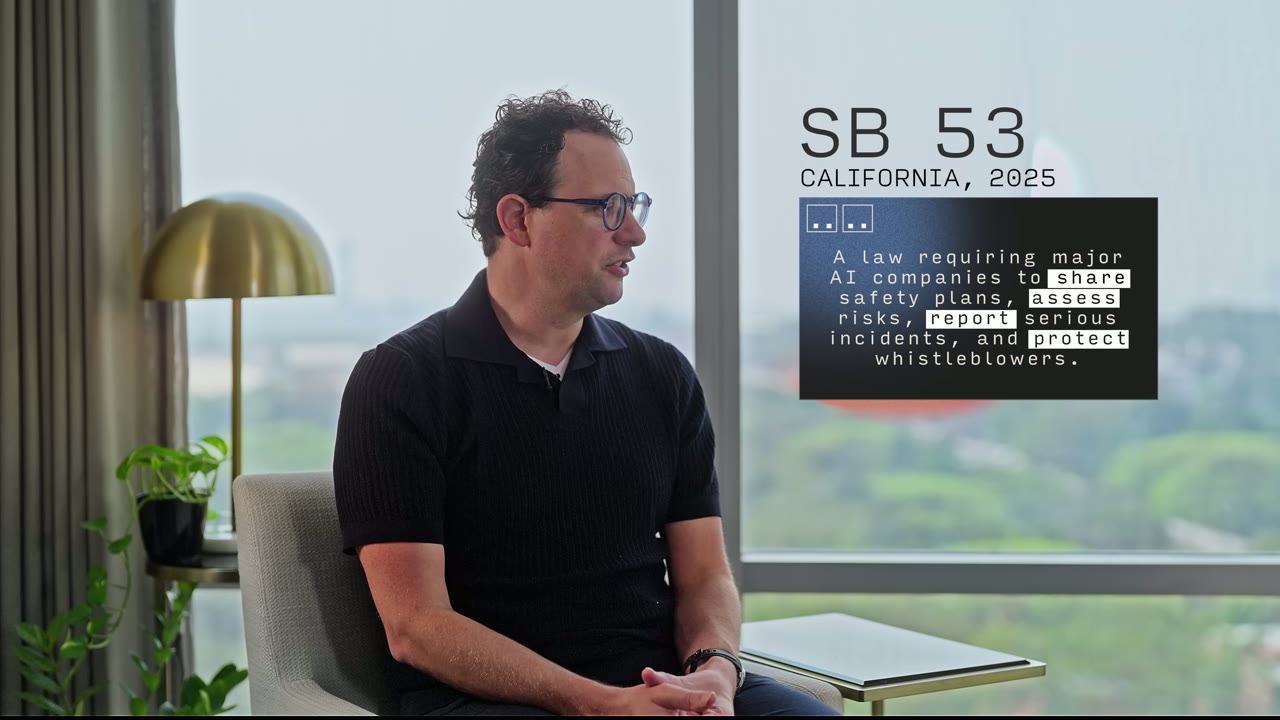

カリフォルニア州SB 53(2025年):AI企業に安全計画の公表を義務付け

根拠

17:41

根拠

17:41

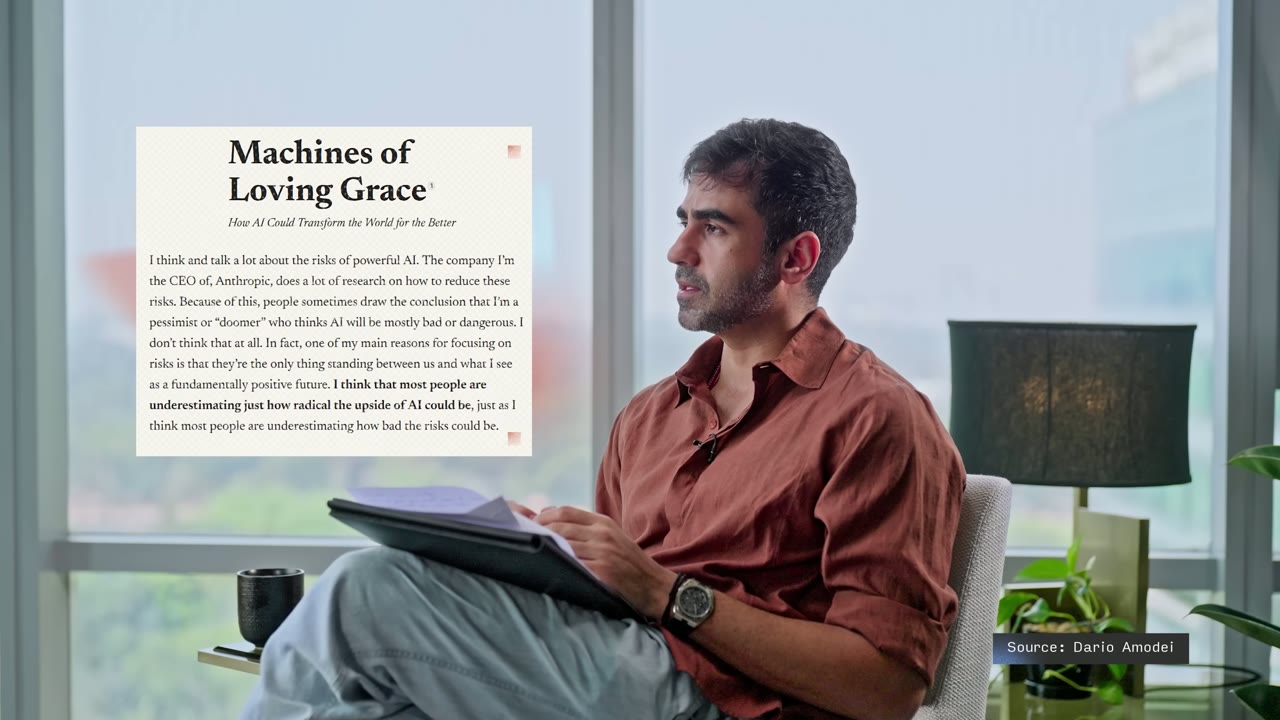

「慈愛に満ちた機械(Machines of Loving Grace)」——アモデイの有益なAIへのビジョン

根拠

12:18

根拠

12:18

Long-Term Benefit Trust(長期利益信託):Anthropicの異例のガバナンス構造

根拠

42:52

根拠

42:52

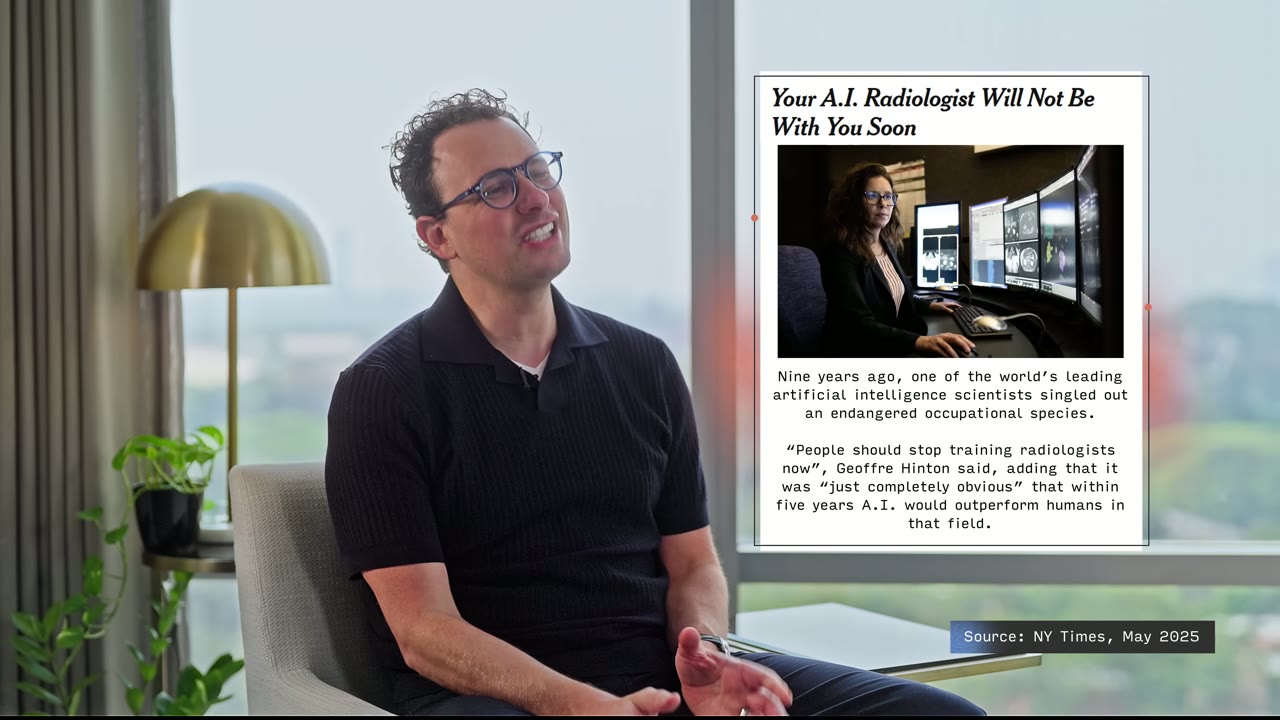

NYT:「あなたのAI放射線科医はすぐには来ない」——現実の確認

文脈

3:45

文脈

3:45

バンガロールでの対談:Dario AmodeiとNikhil Kamath

全文字起こし

YouTube自動字幕より・英語

Transcript data available in transcript_segments.json